ディープラーニング推論エンジン「SoftNeuro®」

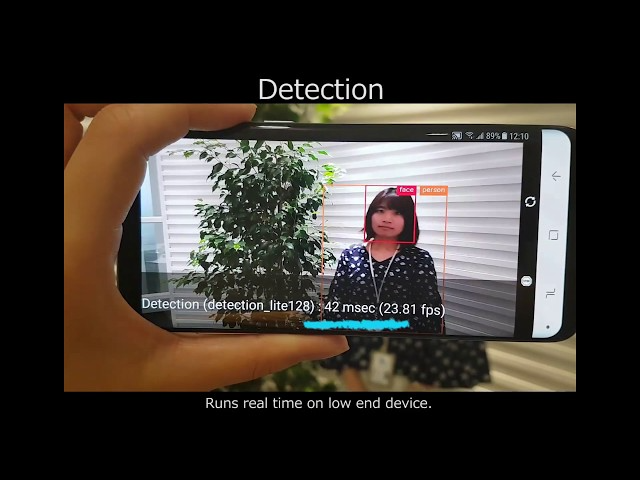

世界最速級のディープラーニング推論エンジン「SoftNeuro®」は、主要なディープラーニング・フレームワークの学習結果を活用し、エッジデバイスを中心に様々な環境上で高速な処理を実現します。

開発チームで座談会を開催し、製品化までの道のりや将来的な方向性などについて本音で語り合いました。

SoftNeuro®

ディープラーニング推論エンジン

「SoftNeuro®」は、世界最速級のディープラーニング推論エンジンです。主要なディープラーニング・フレームワークを用いて行われた学習結果を活用して、エッジデバイスなどの様々な環境上で高速な処理を実行します。